Thomas Wendler legt die Auswertung auf den Tisch und atmet tief durch. Vor 18 Monaten hätte er diesen Moment herbeigesehnt – den Moment, in dem er dem Vorstand sagen kann: „Unser KI-Projekt hat funktioniert." Stattdessen blättert er durch eine Folie voller gelber und roter Ampeln. Budget aufgebraucht. Messbare Wirkung: minimal. Die WEMA-Fertigungstechnik GmbH aus Schweinfurt, 340 Mitarbeiter, seit 1987 Spezialist für CNC-Präzisionsteile in der Automobilzulieferkette, steckt in der 95-Prozent-Falle.

Die Zahl klingt brutal – aber sie ist real. Aktuelle Analysen zeigen, dass rund 95 Prozent der generativen KI-Projekte noch keine messbaren Return-on-Investment erzielen. Für Unternehmen, die in sorgfältig vorbereiteten Pitches von Transformationspotenzial gehört haben, ist das ein Schock. Aber es ist kein Naturgesetz. Es ist eine Frage der richtigen Vorgehensweise – und genau das ist das Thema dieses Artikels.

Das Einstiegsszenario: Wenn KI-Begeisterung auf industrielle Realität trifft

Bei der WEMA-Fertigungstechnik begann alles verheißungsvoll. Der erste Use Case war klar: Ein KI-System sollte Qualitätsmängel an CNC-gefertigten Metallteilen automatisch erkennen – über Kamerasysteme und Bildverarbeitung direkt in der Fertigungslinie. Statt manueller Stichproben würde das System 100 Prozent der produzierten Teile prüfen, rund um die Uhr, ohne Ermüdungserscheinungen und mit konstant hoher Präzision. Theoretisch ein Homerun.

Der Anbieter – ein vielversprechendes Start-up aus München mit beeindruckendem Demo-Material – versprach eine Erkennungsgenauigkeit von 98 Prozent. „In unseren Benchmarks" war der entscheidende Nebensatz, den Thomas Wendler damals überhört hat. Diese Benchmarks basierten auf standardisierten Referenzdatensätzen unter kontrollierten Laborbedingungen. Die Realität bei WEMA sah anders aus: Die Beleuchtungssituation variierte erheblich je nach Maschinentyp und Tageszeit. Die vorhandene Kameraauflösung entsprach nicht den Systemanforderungen. Und die IT-Infrastruktur war auf Edge-KI-Processing schlicht nicht vorbereitet.

Nach drei Monaten Deployment lag die tatsächliche Erkennungsrate bei 71 Prozent – deutlich schlechter als die geschulten menschlichen Prüfer. Das System produzierte vor allem Falschalarm: Einwandfreie Bauteile wurden abgelehnt und mussten manuell nachgeprüft werden. Die Fehlalarmquote war so hoch, dass das Produktionsteam die KI-Empfehlungen schlicht ignorierte und zum bewährten manuellen Prozess zurückkehrte. Das System läuft noch – technisch. Genutzt wird es nicht.

„Wir hatten das Werkzeug – aber nicht das Fundament", sagt Wendler rückblickend. „Ich wusste, was KI theoretisch kann. Aber ich hatte keine Vorstellung davon, was wir intern brauchen, damit sie in unserer spezifischen Umgebung wirklich funktioniert."

Anatomie eines gescheiterten KI-Projekts: Was wirklich schiefläuft

Die Geschichte der WEMA-Fertigungstechnik ist kein Einzelfall. Sie illustriert Muster, die sich branchenübergreifend wiederholen und erklären, warum die Mehrheit der KI-Projekte im Mittelstand hinter den Erwartungen zurückbleibt. Vier Faktoren sind besonders häufig.

Fehler 1: Die Datenbasis wurde überschätzt

KI-Modelle sind exakt so gut wie die Daten, auf denen sie trainiert wurden. Im industriellen Umfeld bedeutet das: historische Qualitätsdaten müssen digitalisiert, konsistent gelabelt und in ausreichender Menge vorhanden sein. Bei WEMA existierten zwar Prüfprotokolle – aber in drei verschiedenen Excel-Formaten, auf zwei getrennten Servern, mit inkonsistenter Kategorisierung je nach Schichtleiter und Produktionsjahr. Bevor ein sinnvolles Modelltraining möglich gewesen wäre, hätte das Unternehmen mindestens drei Monate intensives Data Cleaning und Data Engineering gebraucht.

Diese Phase wurde zugunsten eines schnellen Proof-of-Concept übersprungen. Das ist ein klassischer Fehler, der sich mit schöner Regelmäßigkeit wiederholt: KI-Projekte starten wollen, bevor das Datenfundament steht. Kein Modell der Welt kompensiert schlechte Eingangsdaten – das gilt für einfache Regressionsmodelle genauso wie für die komplexesten neuronalen Netze.

Fehler 2: Der falsche Use Case für den ersten Versuch

Automatische optische Qualitätsprüfung ist technisch hochgradig anspruchsvoll. Für einen Automobilzulieferer, wo ein einziges fehlerhaftes Bauteil eine Rückrufaktion auslösen kann, ist eine Falschalarm- oder Fehlerrate von auch nur 3 bis 5 Prozent betrieblich inakzeptabel. Das ist kein KI-Problem – das ist ein Anforderungsproblem.

Es gibt Use Cases, bei denen 85 Prozent Genauigkeit bereits echten Mehrwert liefern. Predictive Maintenance beispielsweise: Wenn ein Modell vorhersagt, dass eine Maschine in den nächsten 48 Stunden ausfallen könnte, und diese Vorhersage in 80 Prozent der Fälle korrekt ist, lohnt sich die frühere Wartung trotzdem – weil auch die 20 Prozent Fehlprognosen nur zu unnötig früh durchgeführten Wartungen führen, nicht zu Produktionsausfällen. Der Unterschied zur Qualitätsprüfung ist fundamental.

Die Faustregel für den ersten KI-Use-Case: Hoch impactvoll in der Wirkung, niedrig risikovoll bei Fehlentscheidungen. Der erste Use Case dient nicht nur der Wertschöpfung – er ist auch ein Lernprojekt für Team, Prozesse und Vertrauen in die Technologie. Dieser Lernwert geht verloren, wenn das Projekt an zu hohen Anforderungen scheitert.

Fehler 3: Change Management als Nachgedanke

Selbst ein technisch einwandfrei funktionierendes KI-System scheitert, wenn die Menschen, die damit arbeiten sollen, es nicht annehmen. Bei WEMA hatte das Produktionsteam nie wirklich verstanden, warum das System eingeführt wurde, wie es funktioniert und wie seine Empfehlungen zu interpretieren sind. Die erste Welle an Fehlalarmen reichte, um das Vertrauen dauerhaft zu beschädigen.

Erfolgreiche KI-Einführungen behandeln Change Management nicht als nachgelagerten Kommunikationsschritt, sondern als integralen Bestandteil des Projekts. Das bedeutet: Mitarbeitende früh einbinden – idealerweise schon bei der Use-Case-Definition. Erklären, wie das System Entscheidungen trifft. Feedback-Schleifen einbauen, durch die das Team die Modellqualität aktiv verbessern kann. Und eine „Mensch überwacht Maschine"-Kultur etablieren, lange bevor über autonome Entscheidungen nachgedacht wird.

Fehler 4: Kein Plan für den Betrieb nach dem Deployment

Ein KI-Modell ist kein Stück klassische Software, das man einmal installiert und das dann läuft. Es driftet – seine Leistung verschlechtert sich, wenn die reale Welt sich von den Trainingsdaten entfernt. Neue Maschinentypen, veränderte Materialien, saisonale Beleuchtungsvariationen in der Halle, Prozessänderungen – all das kann ein Modell aus dem Gleichgewicht bringen, ohne dass es irgendjemand aktiv verändert hat.

MLOps – Machine Learning Operations – ist das Disziplinfeld, das sich um Betrieb, Monitoring und kontinuierliche Verbesserung von KI-Modellen kümmert. Im Mittelstand ist es noch weitgehend unbekannt. Das Ergebnis: KI-Systeme, die im Monat des Deployments gut funktionieren, aber sechs Monate später schleichend schlechter werden – ohne dass es jemand merkt, bis der Schaden offensichtlich ist.

Die Wende: Wie WEMA-Fertigungstechnik den zweiten Anlauf richtig macht

Nach dem Scheitern des ersten Projekts entschied Thomas Wendler sich für einen Neustart – diesmal mit externer Beratung und einem grundlegend anderen Ansatz.

Der erste Schritt: ein dreimonatiger KI-Readiness-Check. Kein Code, keine Modelle – nur eine systematische, ehrliche Bestandsaufnahme. Welche Daten sind im Unternehmen vorhanden, in welcher Qualität, wie strukturiert? Wie ist der technische Reifegrad der IT-Infrastruktur? Welche internen Kompetenzen existieren bereits? Das Ergebnis war ernüchternd, aber heilsam: WEMA hatte keine tragfähige Datenbasis für anspruchsvolle Computer-Vision-Anwendungen, aber hervorragende Maschinendaten. Die CNC-Steuerungen lieferten seit Jahren automatisiert Vibrations-, Drehmoment- und Temperaturdaten – sauber, konsistent, vollständig.

Der zweite Schritt: Use-Case-Neubewertung. Statt optischer Qualitätsprüfung fokussierte sich das Team auf Predictive Maintenance – die Vorhersage von Werkzeugverschleiß anhand der bereits vorhandenen Sensordaten. Die Datenlage war hervorragend. Die Fehlertoleranz höher – eine Wartung, die zwei Tage früher als nötig stattfindet, ist kein Problem. Und die Instandhaltungsmitarbeitenden waren von Beginn an begeistert, weil sie das System als Entlastung wahrnahmen, nicht als Kontrollinstrument.

Der dritte Schritt: Phased Rollout mit klaren Erfolgskriterien von Anfang an. Monat 1 bis 2: Datensammlung und Baseline-Analyse (wie oft fallen Werkzeuge tatsächlich aus? Was sind die Vorboten?). Monat 3 bis 4: Modelltraining auf historischen Ausfällen. Monat 5: Pilot an zwei Maschinen im „Mensch überwacht Maschine"-Modus, aktives Feedback-Logging. Monat 6: Auswertung gegen vorher definierte Erfolgskriterien.

Das Ergebnis nach sechs Monaten: Eine Reduktion ungeplanter Maschinenstillstände um 34 Prozent an den Pilotmaschinen. Messbar. Dokumentiert. Vom Team angenommen, weil es das System versteht und dessen Output vertraut. Thomas Wendler bereitet gerade den Ausbau auf die restlichen 18 Maschinen vor.

Was die KI-Gewinner im Mittelstand anders machen: Sechs Erfolgsmuster

Die Erfahrungen aus erfolgreichen KI-Projekten im deutschen Mittelstand lassen sich in sechs wiederkehrenden Mustern zusammenfassen, die sich konsistent von den gescheiterten Projekten unterscheiden.

Muster 1: KI-Readiness vor KI-Einsatz

Erfolgreiche Unternehmen investieren mindestens vier bis acht Wochen in eine ehrliche Bestandsaufnahme, bevor sie den ersten Euro für KI ausgeben. Sie wissen, welche Daten sie haben und welche nicht, wie ihre IT-Infrastruktur aufgestellt ist, und welche internen Fähigkeiten bereits vorhanden sind. Diese Klarheit verhindert teure Überraschungen. Sie ermöglicht außerdem realistische Zeit- und Budgetplanung – was wiederum das Vertrauen des Managements stärkt.

Muster 2: Wertschöpfungsorientierte Use-Case-Priorisierung

Die besten Mittelstandsprojekte beginnen nicht mit dem „coolsten" Use Case, sondern mit dem Use Case, der am schnellsten messbaren Wert erzeugt. Eine einfache 2x2-Matrix ist hierbei hilfreich: X-Achse zeigt die geschätzte Wertschöpfung, Y-Achse den Implementierungsaufwand. Das erste Projekt sollte immer im Quadranten „hoher Wert, geringer Aufwand" liegen. Das generiert schnell sichtbare Ergebnisse – und sichert das Budget für die nächsten Schritte.

Muster 3: Interne Eigenverantwortung statt vollständiges Outsourcing

Unternehmen, die KI-Projekte vollständig an externe Anbieter delegieren, verlieren die Kontrolle und das Wissen. Wenn der Anbieter das Modell anpasst, weiterentwickelt oder einstellt, steht das Unternehmen ohne Handlungsfähigkeit da. Erfolgreiche Mittelständler etablieren interne „KI-Owner" – Mitarbeitende aus den Fachabteilungen, die die Lösung verstehen, betreiben und grundlegend beurteilen können. Das Ziel ist nicht, jede Zeile Code selbst zu schreiben. Das Ziel ist, intelligente Entscheidungen über das KI-System treffen zu können.

Muster 4: Iteratives Vorgehen mit kurzen Feedback-Zyklen

Statt 18-Monats-Projekten mit Big-Bang-Deployment setzen die Gewinner auf Sprints von vier bis sechs Wochen, in denen konkrete, messbare Zwischenergebnisse erwartet werden. Wenn ein Zwischenergebnis nicht den Erwartungen entspricht, wird früh korrigiert – nicht kurz vor dem finalen Rollout, wenn Korrekturen teuer und politisch schwierig werden. Diese Agilität ist kein Methodenfetischismus: Sie ist die praktischste Absicherung gegen die klassischen KI-Projektrisiken.

Muster 5: KI-Governance von Tag 1

Der EU AI Act ist in Kraft. Unternehmen, die KI in Hochrisiko-Bereichen einsetzen – Personalentscheidungen, sicherheitskritische Systeme, bestimmte Qualitätssicherungsprozesse – brauchen von Beginn an eine dokumentierte KI-Governance: Wer darf welche KI-gestützten Entscheidungen treffen? Wie werden KI-Empfehlungen auf Plausibilität geprüft? Wie werden Systeme auf Bias und Fehlfunktionen überwacht? Diese Governance ist kein bürokratischer Overhead – sie ist das Fundament für nachhaltigen, rechtssicheren KI-Einsatz. Unser Ansatz zur KI-Compliance bei pleXtec berücksichtigt genau diese regulatorischen Anforderungen.

Muster 6: Klein anfangen, groß denken

Die erfolgreichsten KI-Initiativen im Mittelstand beginnen mit einem eng umrissenen ersten Use Case – aber mit einer klaren Vision, wohin die Reise in 24 bis 36 Monaten gehen soll. Das erste Projekt ist gleichzeitig Lernprojekt und Plattform für alle weiteren Use Cases. Wer jedes KI-Projekt als isoliertes Silo betrachtet, kann nicht skalieren – weder technisch (fehlende gemeinsame Dateninfrastruktur) noch organisatorisch (keine geteilten Kompetenzen). Die Vision gibt die Richtung. Das erste Projekt gibt die Geschwindigkeit.

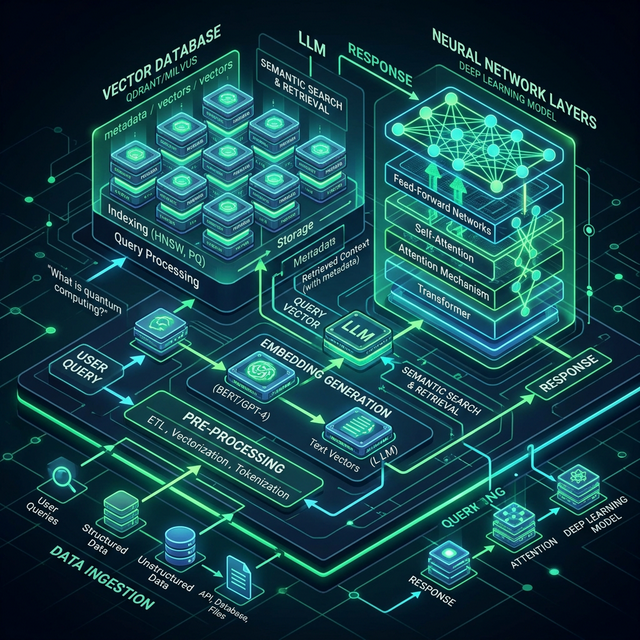

Die technische Perspektive: Was produktive KI im Mittelstand braucht

Hinter jedem erfolgreichen KI-Einsatz im Mittelstand steckt eine Infrastruktur, die in vielen Unternehmen noch fehlt. Hier ein technischer Überblick über die wichtigsten Bausteine:

Data Platform: Das Fundament aller KI

Eine saubere, zugängliche Datenbasis ist nicht verhandelbar. Das bedeutet konkret: ein Data Warehouse oder Data Lake, in dem historische und aktuelle Daten aus verschiedenen Quellen zusammengeführt und in konsistenter Qualität gehalten werden. In der industriellen Praxis heißt das oft: ERP-Daten, MES-Daten, SCADA-Daten und IoT-Sensordaten müssen über Pipelines integriert werden. Tools wie Apache Airflow für die Orchestrierung, dbt für Datentransformationen und ein einfacher Data Catalog als Dokumentationsebene bilden ein solides Fundament – ohne Enterprise-Budget zu erfordern.

# Beispiel: Einfache Datenpipeline für Maschinensensordaten

import pandas as pd

from sqlalchemy import create_engine

from datetime import datetime, timedelta

def load_sensor_data(machine_ids: list, days_back: int = 365) -> pd.DataFrame:

"""Maschinendaten der letzten N Tage laden und vorbereiten."""

engine = create_engine('postgresql://user:pass@host/prod_db')

start_date = datetime.now() - timedelta(days=days_back)

query = f"""

SELECT

timestamp,

machine_id,

vibration_rms,

torque_nm,

temperature_celsius,

tool_runtime_hours,

is_maintenance_event

FROM sensor_readings

WHERE timestamp >= '{start_date.isoformat()}'

AND machine_id = ANY(ARRAY{machine_ids})

ORDER BY machine_id, timestamp;

"""

df = pd.read_sql(query, engine)

# Datenqualität prüfen

missing = df.isnull().sum()

if missing.any():

print(f"WARNUNG: Fehlende Werte gefunden:\n{missing[missing > 0]}")

return df

# Laden und Basis-Analyse

df = load_sensor_data(machine_ids=[101, 102, 103, 104], days_back=730)

print(f"Datensätze: {len(df):,}")

print(f"Zeitraum: {df.timestamp.min()} bis {df.timestamp.max()}")

print(f"Wartungsereignisse: {df.is_maintenance_event.sum()}")Modelltraining: Pragmatismus vor Purismus

Für viele Mittelstandsprojekte sind vorgefertigte, feinjustierbare Modelle der sinnvollste Startpunkt – kein Training von Grund auf. AutoML-Plattformen wie Google Vertex AI AutoML, Microsoft Azure AutoML oder open-source Alternativen wie AutoGluon ermöglichen es, ohne Deep-Learning-Expertise in kurzer Zeit robuste Modelle für tabellarische Daten zu entwickeln. Für Predictive Maintenance an Maschinen – wie im WEMA-Beispiel – sind Gradient Boosting-Ansätze (XGBoost, LightGBM) oft sogar überlegen gegenüber komplexeren neuronalen Netzen, weil sie besser mit strukturierten Sensordaten umgehen und besser erklärbar sind.

Die entscheidende Kompetenz liegt weniger im Training als in der Validierung: Wie gut funktioniert das Modell auf den echten Produktionsdaten? Wie stabil ist die Leistung über Zeit? Hier sind zeitliche Kreuzvalidierungsstrategien wichtig – man muss sicherstellen, dass das Modell auf zukünftigen Daten validiert wird, nicht auf Vergangenheitsdaten, die es bereits „gesehen" hat.

MLOps: Den Betrieb von Anfang an mitdenken

Ein Modell, das heute gut funktioniert, kann in drei Monaten schlechter werden – ohne dass es jemand bewusst verändert hat. Model Drift ist real und muss proaktiv erkannt werden. Ein minimales MLOps-Setup für den Mittelstand umfasst drei Komponenten:

Erstens Modell-Monitoring: Automatische Überwachung der Vorhersagequalität in der Produktion, verglichen mit dem tatsächlichen Ergebnis (Ground Truth). Im Predictive-Maintenance-Kontext heißt das: Wenn das Modell eine Wartung vorhersagt, wird danach geprüft, ob tatsächlich ein Verschleiß vorlag. Diese Daten fließen automatisch in ein Reporting-Dashboard.

Zweitens Data Drift Detection: Statistische Überwachung, ob sich die Eingangsdaten (Sensorwerte, Prozessparameter) merklich von den Trainingsdaten entfernen. Tools wie Evidently AI oder eigene statistische Tests (KS-Test, PSI-Score) können hier einfach und günstig implementiert werden.

Drittens Retraining-Pipelines: Automatisierte Prozesse, um Modelle bei erkanntem Drift mit neuen Daten nachzutrainieren – oder zumindest eine Benachrichtigung auszulösen, die manuelle Prüfung anregt. Für den Mittelstand ist MLflow als open-source MLOps-Plattform ein bewährter Einstieg: Es ist frei verfügbar, gut dokumentiert und lässt sich graduell einführen.

KI-Strategie mit pleXtec: Unser Ansatz für den Mittelstand

Bei pleXtec begleiten wir Mittelstandsunternehmen auf genau diesem Weg – vom ersten strategischen Gespräch bis zum produktiven KI-System im Betrieb. Unser Ansatz beginnt immer mit einer strukturierten KI-Strategie-Beratung, in der wir gemeinsam herausarbeiten, welche Use Cases für Ihr Unternehmen wirklich relevant sind und welche Voraussetzungen Sie bereits erfüllen.

Dabei legen wir besonderen Wert auf drei Prinzipien. Erstens: Nüchterner Realismus. Wir versprechen keine Wunder und keine Prozentzahlen, die wir nicht belegen können. Wir helfen Ihnen zu verstehen, was KI in Ihrer spezifischen Situation leisten kann – und was nicht. Das schützt Sie vor falschen Erwartungen und dem daraus folgenden Vertrauensverlust.

Zweitens: Nachhaltiger Wissensaufbau. Unsere Projekte sind so konzipiert, dass Ihr Team am Ende in der Lage ist, die KI-Lösung selbst zu betreiben, zu überwachen und weiterzuentwickeln. Wir trainieren Ihre Mitarbeitenden nicht nur im Bedienen des Systems, sondern im Verstehen seiner Logik und Grenzen. Informationen zu unseren technischen Entwicklungsleistungen finden Sie auf der entsprechenden Seite.

Drittens: Technische Exzellenz. Von der Datenarchitektur über das Modell-Design bis zur MLOps-Infrastruktur bauen wir auf Fundamente, die langfristig tragen. Keine Bastelprojekte, die beim ersten Software-Update oder Mitarbeiterwechsel zusammenbrechen. Keine proprietären Lösungen, die Sie dauerhaft an einen Anbieter binden.

Ein realistischer Zeitplan: Was Sie in 12 Monaten erwarten können

Um Erwartungen zu kalibrieren, hier ein realistischer Zeitplan für ein erstes KI-Projekt im Mittelstand – basierend auf unserer Projekterfahrung:

Monate 1–2: Vorbereitung. KI-Readiness-Assessment, Use-Case-Auswahl, Daten-Inventur, Definition von Erfolgskriterien. Kein Code, keine Modelle. Nur solide Grundlagenarbeit, die alles weitere trägt.

Monate 3–4: Fundament legen. Datenpipeline aufbauen, historische Daten bereinigen und strukturieren, erste explorative Analysen und Visualisierungen. Hier zeigt sich, ob die Datenbasis für den gewählten Use Case ausreicht – oder ob nachgebessert werden muss.

Monat 5: Modell-Prototyp. Erstes Modell trainieren und intern validieren. Noch kein Produktivbetrieb. Die zentrale Frage: Ist das Modell grundsätzlich vielversprechend genug, um es zu deployen – oder muss der Ansatz geändert werden?

Monate 6–7: Pilotbetrieb. Deployment in begrenztem Umfang – zwei bis drei Maschinen, eine Abteilung, ein Standort – mit aktivem Monitoring, User-Feedback-Logging und engem Austausch zwischen IT und Fachabteilung.

Monat 8: Auswertung. Haben die Erfolgskriterien aus Monat 1 sich erfüllt? Wenn ja: Ausbau planen. Wenn nein: ehrliche Analyse der Ursachen und Kurskorrektur. Beides ist ein gutes Ergebnis – weil es auf echten Daten basiert.

Monate 9–12: Skalierung. Ausweitung auf weitere Bereiche oder Standorte, Optimierung des Modells mit mehr Produktionsdaten, Aufbau interner Kompetenzen für eigenständigen Betrieb.

Zwölf Monate für den ersten vollständigen KI-Zyklus – das klingt nach viel. Aber es ist die ehrliche Zeitlinie. Unternehmen, die diesen Zeitplan unterschreiten wollen, riskieren genau die Fehler, die zur 95-Prozent-Statistik beitragen.

Ausblick: 2026 als Wendepunkt für KI im Mittelstand

Die gute Nachricht: 2026 ist ein echter Wendepunkt. Die Technologie ist gereifter. Die Anbieter-Landschaft hat sich konsolidiert – weniger Hype, mehr Substanz. Die Verfügbarkeit sauberer Industrie-Daten steigt, weil immer mehr Maschinen und Prozesse automatisch digitale Daten erzeugen. Und die KI-Fähigkeiten, die vor drei Jahren noch Millionen-Investitionen erforderten, sind heute für mittelständische Budgets zugänglich.

Gleichzeitig steigt der Wettbewerbsdruck. Unternehmen, die KI konsequent und methodisch einsetzen, werden messbare Produktivitäts- und Qualitätsvorteile realisieren. Für ihre Wettbewerber, die weiter auf Pilotprojekt-Niveau verharren, wird der Abstand Jahr für Jahr schwerer aufzuholen sein.

Der entscheidende Unterschied zwischen KI-Gewinnern und KI-Verlierern liegt nicht in der Technologiewahl. Er liegt in der Konsequenz der Umsetzung: klare Ziele, ehrliche Bestandsaufnahme, methodisches Vorgehen und die Bereitschaft, aus frühen Misserfolgen zu lernen statt sie zu wiederholen.

Thomas Wendler von der WEMA-Fertigungstechnik bereitet gerade den Bericht für den dritten Monat seines Predictive-Maintenance-Projekts vor. Alle Ampeln stehen auf Grün. Die ungeplanten Maschinenstillstände sind um 34 Prozent gesunken. Das Instandhaltungsteam fragt selbst nach, wann das nächste Feature kommt. Und der CEO möchte wissen, welche anderen Bereiche man damit angehen kann.

So sieht KI aus, die funktioniert. Nicht als Pilot, nicht als Demo – sondern als Teil des Betriebs. Wenn Sie wissen möchten, wie Ihr Unternehmen diesen Schritt machen kann, sprechen Sie uns an. Gemeinsam analysieren wir Ihren KI-Readiness-Stand und entwickeln einen realistischen Weg nach vorne.